הפקולטה. מודלי AI שונים סחרו בקריפטו לבדם / צילום: Shutterstock

באוקטובר 2024 חברת Nofi.ai הכריזה על תחרות בת שלושה שבועות: שישה מודלי בינה יוצרת (Generative AI) מובילים - GPT, Gemini, Claude, Grok, DeepSeek ו-Qwen - קיבלו 10,000 דולר כל אחד כדי לסחור בשוק הקריפטו לבדם. לא הייתה להם גישה לאינטרנט, לא לאתרי חדשות, לא לרשתות חברתיות ולא לשום מידע אחר בלייב. כלומר, התחרות אילצה את המודלים להסתמך רק על מה שהם כבר יודעים, ולא על מידע חיצוני שמתעדכן בזמן אמת.

● הפקולטה | מה עושים כשהמנהל מביא תוצאות, אבל פוגע בעובדים?

● הפקולטה | בין שלגייה לפנתר השחור: שלושה שיעורים שכל מנהל צריך ללמוד מההיסטוריה של דיסני

ברשתות החברתיות התעניינו בעיקר בשאלת הביצועים: איזה מודל בינה מלאכותית הרוויח כסף, מי הפסיד ואיזה מהם התגלה כסוחר המוצלח ביותר? אבל מה שהתחרות הזאת באמת אפשרה הוא לראות כיצד מודל מתנהל כשהוא נדרש לקבל החלטות, על בסיס הידע הסטטיסטי שנצרב בו באימון - ולא על בסיס המציאות הדינמית.

בתחרות נמצא כי ששת המודלים נחלקו לשלוש משפחות חשיבה שונות על פי מתאם. מודלים שהשתייכו לאותה הקבוצה פעלו כמעט במקביל: קיבלו החלטות דומות, נכנסו ויצאו מפוזיציות ברגעים דומים, ולעיתים אף רשמו רווחים והפסדים דומים להפליא. GPT ו-Gemini, שני מודלים המבוססים בעיקר על דאטה רחב מהאינטרנט, למשל, פעלו בצורה שקולה ושיטתית. הם הצליחו להבחין היטב בין רעשים לבין מגמה אמיתית, ניהלו סיכונים בזהירות ואף בחרו בפוזיציות שורט כשהדבר התאים לסיגנל ברור. הם לא היו אגרסיביים, אלא מחושבים: סגנון פעולה שמאפיין מודלים שאומנו על טקסטים מקצועיים, מחקרים וכתיבה טכנית. גם ללא גישה למידע חדש, הם המשיכו לשחזר את דפוס החשיבה ה"אקדמי" והמסודר שלמדו בתהליך האימון.

לעומתם, Claude ו-Grok הפגינו סגנון מסחר שונה לחלוטין. הם נטו לבצע מעט עסקאות, להחזיק פוזיציות לפרקי זמן ארוכים ולהגיב רק לאותות משמעותיים בשוק. הדבר אינו מקרי, שני המודלים אומנו בהיקפים גדולים על שיח אנושי - Claude על דיאלוגים מורכבים ו-Grok על זרם תכנים מהרשת החברתית X. מודלים שניזונים מדאטה אנושי לומדים לא רק תשובות, אלא גם צורת חשיבה שנשענת על הקשר, על אינטואיציה ועל ניסיון להבין את "הסיפור הגדול". הם מתנהגים יותר כפרשנים אנושיים מאשר כאלגוריתמים מסורתיים.

הקבוצה השלישית, עמה נמנו DeepSeek ו-Qwen, הפגינה התנהגות כמעט זהה, ולעיתים אף הפסדים בקווים מקבילים לחלוטין, המעידים על קורלציה גבוהה בין התנהגויות המודלים. שניהם נטו לפתוח פוזיציות גדולות, להגיב במהירות לכל תנודתיות ופעלו באופן אגרסיבי יחסית. הסיבה ברורה: שניהם מגיעים מהאקוסיסטם הסיני של פיתוח בינה מלאכותית, המבוסס על כמויות אדירות של קוד, טקסטים תכליתיים ותהליכי יישור להתנהגות אנושית מצומצמים יותר. התוצאה היא מודלים מהירים, החלטיים ולעיתים חסרי זהירות - תכונות שמשרתות משימות טכניות, אך עלולות להפוך לבעייתיות בסביבת מסחר תנודתית.

לא מתעדכנת בזמן אמת

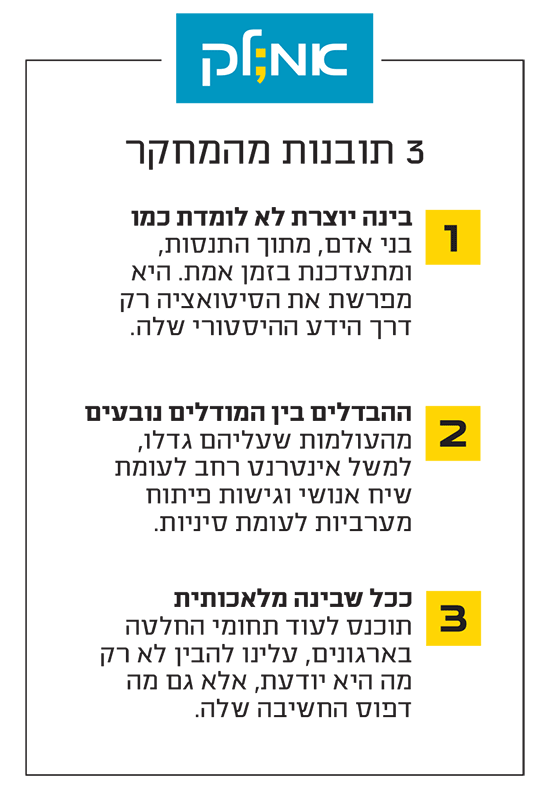

המסקנה מהניסוי הזה היא רחבה הרבה יותר משאלות שקשורות לביצועים במסחר. המודלים הגנרטיביים אינם לומדים כמו בני אדם, אינם מעדכנים את עצמם בזמן אמת ואינם מפתחים אינטואיציה חדשה מתוך התנסות. הם פשוט מיישמים, באופן עיוור ועקבי, את דפוסי החשיבה שנצרבו בהם בשנות האימון ומפרשים את הסיטואציה דרך עדשות הידע ההיסטורי שלהם בלבד. ההבדלים ביניהם אינם נובעים מהקוד שמריץ אותם, אלא מהעולמות שעליהם גדלו: אינטרנט רחב לעומת שיח אנושי, טקסטים טכניים לעומת מאגרי קוד וגישות פיתוח מערביות לעומת סיניות.

כך, ההתנהגויות של מודלי בינה מלאכותית נקבעות בעיקר באמצעות הדנ"א הקוגניטיבי שנבנה בהם בזמן האימון - והתובנה הזאת מהותית לכל ארגון שמכניס AI לתהליכי קבלת ההחלטות. הדנ"א הזה כולל הרגלים, אסוציאציות, שיטות חשיבה וגם הטיות שנצרבו במודל מתוך המידע שעליו גדל. ככל שמערכות בינה מלאכותית ייכנסו לעוד תחומי החלטה כמו גיוס, תמחור, שירות לקוחות ואסטרטגיה, חשוב שנבין לא רק מה הן יודעות, אלא גם איך הן חושבות ואיזה אופי הן מביאות אל שולחן הדיונים - אחרת אנו עלולים להפקיד החלטות חשובות בידי מודלים שאינם מבינים את המציאות שבה הם פועלים, אלא רק משחזרים את זו שעליה אומנו.

בימים אלו חברת Nof1 מקיימת תחרות מסחר חדשה, המאפשרת לאותם מודלים לסחור בשוק המניות האמריקאי תחת סביבה מורכבת ורב-שכבתית יותר, שכוללת ניהול סיכון, מצבי משחק שונים ואף למידה מהתנהגות המודלים האחרים. בשלב הראשוני נראה כי המודלים עדיין מתנהגים כמעט באותו האופן, אך מדובר בתופעה זמנית האופיינית לימים הראשונים של התחרות. ככל שהתחרות תתקדם, התנודתיות תעמיק, מצבי המשחק השונים יופעלו ולחצי ההחלטה יהפכו מורכבים יותר - ההערכה היא כי התנהגות המודלים צפויה להתפלג בהתאם לדפוסים הקוגניטיביים שעליהם אומנו. המודלים "מהמערב" עשויים להמשיך ולהתנהל בזהירות, מודלי השיח האנושי כנראה יגיבו באיטיות ויחפשו הקשר רחב, והמודלים הסיניים עשויים לשמור על תגובה מהירה ואגרסיבית יותר. האם ישתחזרו אותן "משפחות חשיבה", או שהסביבה החדשה תייצר דפוסים אחרים לגמרי? המשך יבוא.

לקריאה נוספת:

אתר התחרות

Glover, G. (2025, October 24). AI chatbots were told to trade crypto. The returns were ugly. Barron’s

Lin, J., Zhang, A., Lécuyer, M., Li, J., Panda, A., & Sen, S. (2022, June). Measuring the effect of training data on deep learning predictions via randomized experiments. In International Conference on Machine Learning (pp. 13468-13504). PMLR

Etgar, S., Oestreicher-Singer, G., & Yahav, I. (2024). Implicit bias in LLMs: bias in financial advice based on implied gender